L’essentiel à retenir : Google Research lance TurboQuant, un algorithme réduisant par six la mémoire des caches KV sans réentraînement. Cette innovation combine les coordonnées polaires de PolarQuant et la correction d’erreurs QJL pour lever les goulots d’étranglement des GPU Nvidia H100. Elle booste la vitesse d’inférence par 8 tout en préservant 99,5 % de fidélité. Pour en discuter directement: Contactez- nous!

Vos GPU Nvidia H100 saturent-ils sous le poids des caches KV lors de l’inférence de contextes longs ? L’algorithme google turboquant résout ce goulot d’étranglement en compressant la mémoire par six sans sacrifier la précision des modèles Gemma ou Mistral. Découvrez comment cette innovation de Google Research booste les performances par huit grâce à la méthode PolarQuant et une correction d’erreurs mathématique inédite.

Algorithme Google TurboQuant et gestion des caches KV

Après des mois de spéculation sur l’efficacité des LLM, Google Research vient de frapper un grand coup avec TurboQuant, une solution qui s’attaque au cœur du problème : la mémoire vive des GPU.

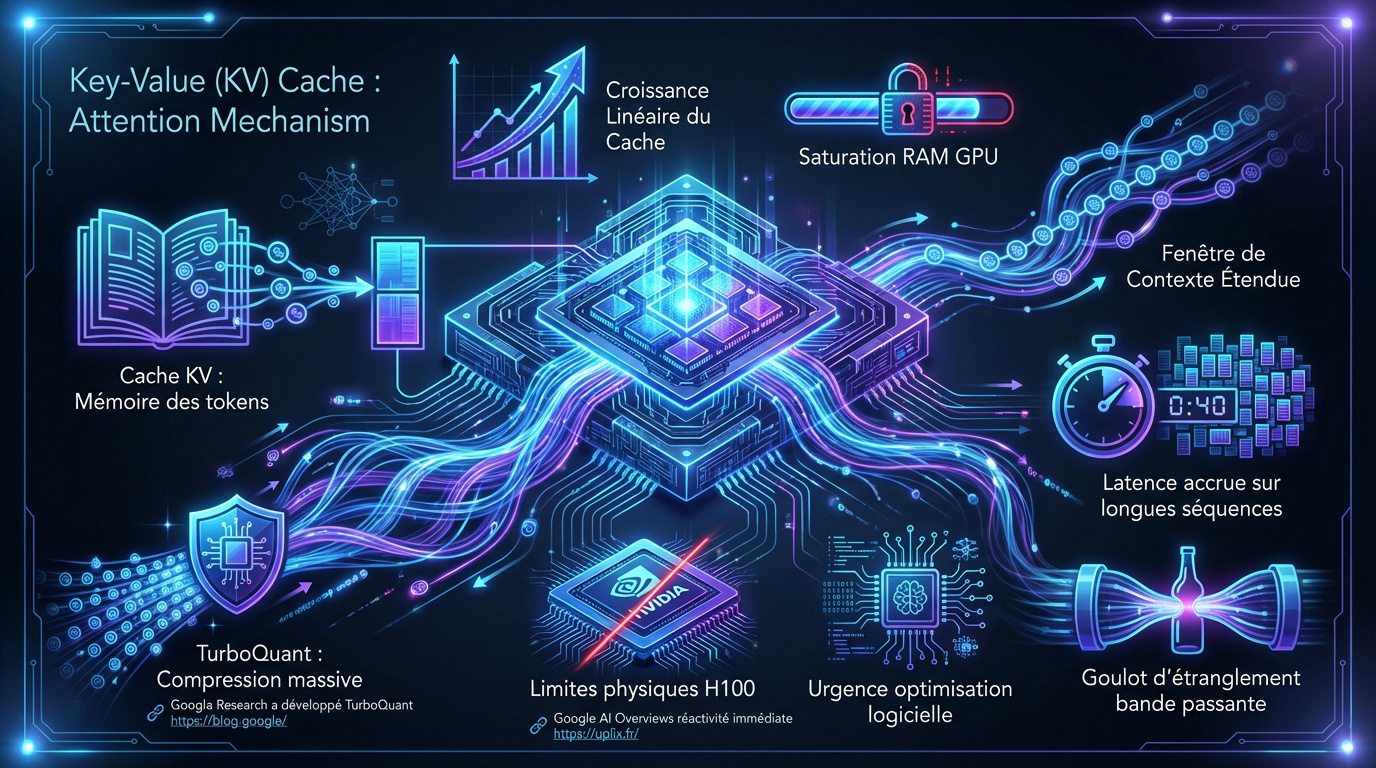

Rôle du Key-Value Cache dans l’inférence

Le KV Cache sert de journal de bord pour les tokens déjà générés. Il évite de recalculer tout le contexte à chaque nouveau mot produit par l’IA. Ce mécanisme optimise la vitesse de réponse.

Cependant, ce cache subit une croissance linéaire. Plus la fenêtre de contexte s’allonge, plus la RAM du GPU sature rapidement. C’est le point critique pour les modèles à 128k tokens ou plus.

Pour résoudre ce problème, Google Research a développé TurboQuant. Cet algorithme permet une compression massive des données sans sacrifier la précision globale du modèle.

Limites physiques des accélérateurs Nvidia H100

L’architecture Hopper de Nvidia présente un goulot d’étranglement majeur. La puissance de calcul brute est impressionnante, mais la bande passante mémoire bride les performances réelles en production intensive. Le transfert des données devient lent.

La latence chute drastiquement sur les séquences longues. Le temps nécessaire par token explose quand le système doit jongler avec des gigaoctets de données KV non compressées. Cela impacte directement l’expérience utilisateur finale.

Cette réactivité est pourtant cruciale pour les Google AI Overviews. Ces systèmes demandent une réponse immédiate pour satisfaire les intentions de recherche.

L’optimisation logicielle devient urgente face aux limites matérielles actuelles de Nvidia. TurboQuant apporte une réponse concrète à ce défi.

Fondements mathématiques de PolarQuant et QJL

Pour briser ce plafond de verre, Google n’a pas simplement ajouté des serveurs, mais a repensé la géométrie même des données stockées.

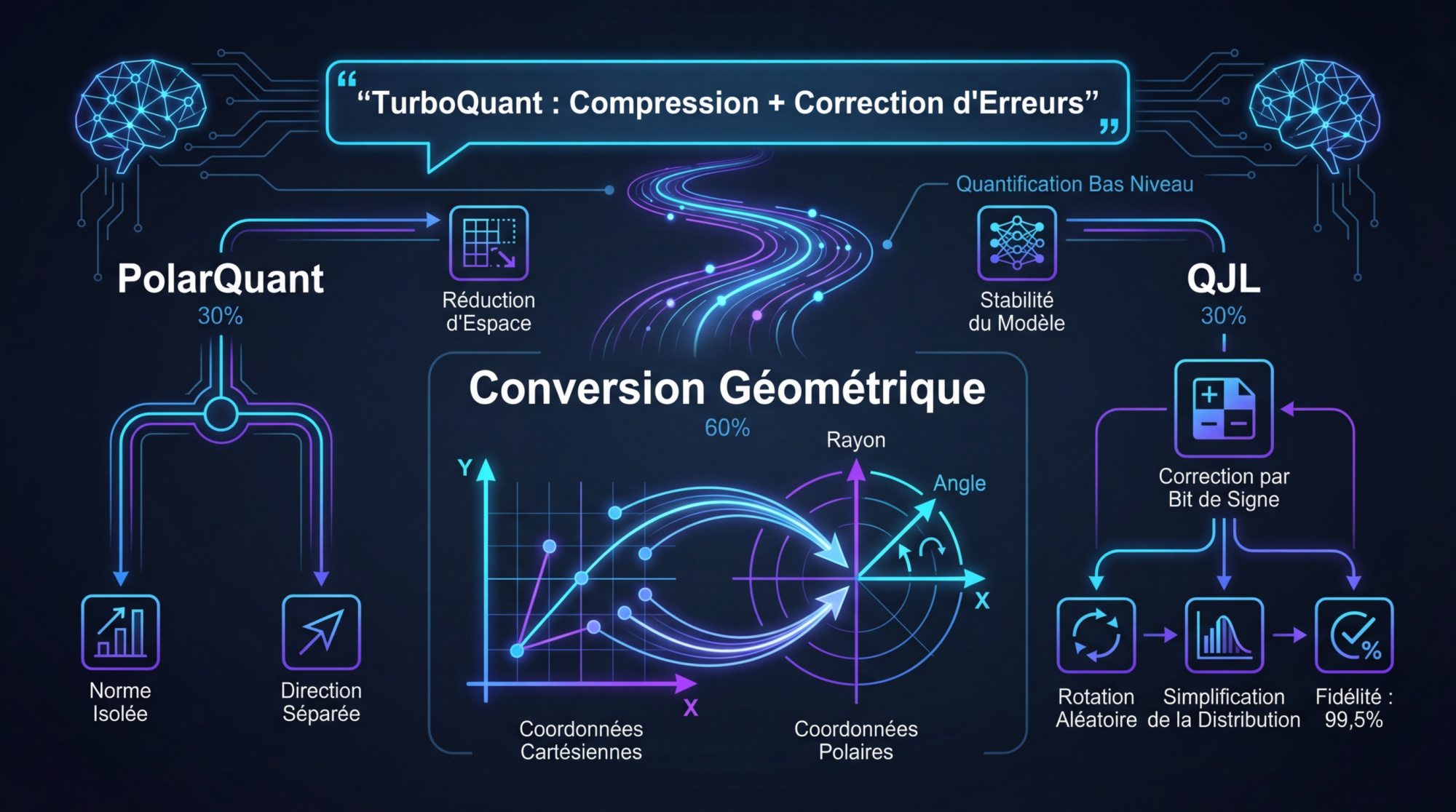

Conversion géométrique en coordonnées polaires

Le système convertit les vecteurs cartésiens classiques en rayons et angles. Cette méthode nommée PolarQuant isole la magnitude de la direction. L’approche mathématique s’avère très élégante pour l’inférence. Elle exploite la concentration des distributions angulaires.

Traiter séparément la norme et l’orientation optimise la compression. On réduit drastiquement l’espace nécessaire sans dégrader l’information sémantique. Cela élimine le besoin de stocker des constantes de quantification coûteuses.

TurboQuant opère en deux étapes clés : une compression utilisant PolarQuant et l’élimination des erreurs via l’algorithme QJL.

Correction d’erreurs par le bit de signe QJL

La transformée Quantized Johnson-Lindenstrauss gère les erreurs résiduelles de manière probabiliste. Ce mécanisme assure la stabilité du modèle après compression. Le génie réside dans cette gestion mathématique des déviances.

Un simple bit de signe corrige les biais systématiques. Cette technique intervient lors de la quantification à très bas niveau. Elle stabilise les scores d’attention des LLM comme Gemma ou Mistral.

- Rotation aléatoire des données

- Simplification de la distribution

- Correction par bit de signe

Cette précision conserve 99,5% de la fidélité de l’attention. L’impact sur la latence reste négligeable.

Quels sont les gains réels sur Nvidia H100 ?

La théorie est séduisante, mais voyons comment ce monstre mathématique se comporte une fois injecté dans les GPU les plus puissants du marché.

Analyse des benchmarks LongBench et RULER

TurboQuant réduit la mémoire du cache KV par six. Il multiplie par huit les performances d’inférence sur le GPU H100.

Sur « Needle In A Haystack », l’algorithme est impressionnant. Malgré une compression à 3 bits, la précision reste totale. Les benchmarks LongBench confirment cette supériorité technique face aux solutions actuelles.

Cette innovation s’inscrit parfaitement dans la nouvelle stratégie IA de Google en 2025 pour les modèles à long contexte.

La compression extrême ne sacrifie plus la précision. La mémoire de travail reste intacte et fiable.

Accélération des logits et compression à 3 bits

Le gain de performance est massif. Le calcul des logits d’attention s’exécute 8 fois plus vite. Le saut technologique dépasse largement les capacités des clés 32 bits classiques.

Les ratios de rappel surpassent les standards habituels. Les méthodes comme 4-bit INT sont distancées en fidélité. TurboQuant impose désormais une nouvelle norme de compression.

Les tests confirment l’accélération de la mémoire IA par 8 sur les infrastructures modernes.

L’efficacité logicielle autorise le traitement de contextes massifs. Un seul nœud de calcul suffit désormais.

Impact économique de l’optimisation sans réentraînement

Au-delà des prouesses techniques, c’est l’aspect financier qui risque de faire basculer l’industrie vers cette nouvelle norme.

Adoption facilitée par la nature data-oblivious

Google Research propose une technologie sans phase de fine-tuning. TurboQuant est « data-oblivious » par nature. On l’applique directement sur un modèle existant sans dépenser un centime en réentraînement.

L’intégration dans les systèmes distribués est immédiate. Les ingénieurs l’injectent sans modifier l’architecture profonde. C’est un gain de temps précieux pour les déploiements de modèles comme Gemma ou Mistral.

Cette approche garantit une flexibilité maximale pour les entreprises :

- Pas de phase de calibration

- Compatibilité immédiate LLM

- Usage gratuit pour les entreprises

Réduction des coûts d’infrastructure GPU

L’empreinte mémoire diminue drastiquement avec cet algorithme. Diviser le besoin en RAM par six permet de faire tourner des modèles massifs sur des infrastructures modestes. C’est une victoire concrète pour la sobriété numérique.

Le potentiel pour l’IA embarquée est immense. Les smartphones géreront bientôt des contextes longs sans aucune surchauffe matérielle.

Pour en discuter directement: Contactez- nous!

TurboQuant rend l’IA de pointe accessible. Elle devient enfin économiquement viable pour tous.

L’algorithme Google TurboQuant révolutionne l’efficience des LLM en compressant les caches KV à 3 bits sans perte de précision. Cette innovation multiplie par huit les performances sur Nvidia H100 tout en divisant les besoins en RAM par six. Adoptez dès maintenant cette solution sans réentraînement pour pérenniser vos infrastructures IA.

FAQ

Qu’est-ce que l’algorithme Google TurboQuant et quel est son rôle ?

TurboQuant est un algorithme de compression sans entraînement développé par Google Research. Il est conçu pour réduire l’empreinte mémoire des caches clé-valeur (KV) dans les grands modèles de langage (LLM) et les moteurs de recherche vectorielle.

Son rôle principal est de compresser les données massives générées lors de l’inférence sans sacrifier la précision. Cette technologie permet de gérer des fenêtres de contexte plus larges tout en optimisant l’utilisation des ressources matérielles existantes.

Comment fonctionnent les mécanismes PolarQuant et QJL au sein de TurboQuant ?

Le processus se déroule en deux étapes mathématiques distinctes. PolarQuant convertit d’abord les vecteurs de coordonnées cartésiennes en coordonnées polaires, isolant le rayon de l’angle pour simplifier la géométrie des données. Cette méthode élimine le besoin de normalisation par bloc coûteuse en mémoire.

Ensuite, l’algorithme QJL (Quantized Johnson-Lindenstrauss) intervient comme un correcteur d’erreurs. Il réduit les résidus à un simple bit de signe (+1 ou -1) pour éliminer les biais systématiques. Cette combinaison permet d’atteindre une compression extrême à 3 bits avec une fidélité d’attention de 99,5 %.

Quels sont les gains de performance mesurés sur les GPU Nvidia H100 ?

Sur les accélérateurs Nvidia H100, l’utilisation de TurboQuant en 4 bits permet d’augmenter la vitesse de calcul des logits d’attention jusqu’à 8 fois par rapport aux clés 32 bits classiques. Cette accélération logicielle compense les limites physiques de la bande passante mémoire du matériel.

En complément de ce gain de vitesse, l’algorithme réduit la capacité mémoire requise par un facteur de six. Les tests sur les benchmarks LongBench et RULER confirment que ces performances sont atteintes sans aucune perte d’exactitude pour des modèles comme Gemma ou Mistral.

Quels sont les avantages économiques de TurboQuant pour les infrastructures IA ?

L’avantage majeur réside dans sa nature data-oblivious, ce qui signifie qu’il ne nécessite aucun réentraînement ni affinage (fine-tuning) du modèle. Les entreprises peuvent l’intégrer immédiatement dans leurs systèmes distribués, réduisant ainsi les coûts opérationnels de 50 % selon certaines analyses.

En divisant par six les besoins en RAM GPU, TurboQuant permet de faire tourner des modèles complexes sur des infrastructures plus modestes. Cela favorise également le déploiement de l’IA sur des appareils locaux, tels que les smartphones, en limitant la surchauffe et la consommation énergétique.

TurboQuant améliore-t-il également la recherche vectorielle ?

Oui, TurboQuant offre des performances supérieures aux méthodes standards comme la Product Quantization (PQ). Il affiche des ratios de rappel 1@k optimaux sur le dataset GloVe, même face à des systèmes utilisant des codebooks plus volumineux.

Cette efficacité rend la recherche sémantique à grande échelle plus rapide et moins coûteuse. L’algorithme permet aux moteurs de recherche de fonctionner avec la réactivité d’un système 3 bits tout en conservant la précision des modèles beaucoup plus lourds.