L’essentiel à retenir : le passage au Generative Engine Optimization (GEO) exige une crédibilité accrue pour être cité par les LLMs. L’autorité et la fraîcheur des contenus deviennent les leviers majeurs contre l’invisibilité. Une étude de 201 audits montre que 18,9 % des sites échouent techniquement face aux agents IA. Pour en discuter directement: Contactez- nous!

Votre marque disparaît-elle des résultats générés par l’intelligence artificielle malgré vos efforts SEO traditionnels ? Un audit de visibilité IA rigoureux portant sur 201 sites révèle que 18,9 % des domaines échouent systématiquement à cause de barrières techniques opaques ou d’un déficit de preuves d’autorité flagrant. Cette analyse technique décortique les performances disparates de dix industries clés pour identifier les leviers précis du Generative Engine Optimization, permettant ainsi de transformer la menace du trafic zero-click en une opportunité de croissance stratégique mesurable par la part de modèle et la validation sémantique des entités.

Du SEO traditionnel au Generative Engine Optimization

La recherche subit une mutation profonde, forçant les marques à repenser leur visibilité au-delà des simples liens bleus.

Conséquences des résumés IA sur le trafic organique

Le CTR organique s’effondre de 61 % avec les AI Overviews. L’internaute trouve sa réponse directement dans l’interface Google. Le clic vers le site source disparaît alors totalement.

L’utilisateur passe d’une recherche active à une consommation passive de données. L’IA agit comme un filtre qui digère l’information brute. Le site web n’est plus la destination finale.

Le trafic zero-click n’est plus une exception, c’est devenu la norme imposée par les moteurs génératifs en 2025.

Découvrez pourquoi Google Search reste dominant face aux recherches par IA malgré cette tendance.

Enjeux financiers de la citation par les agents intelligents

Obtenir une citation devient le nouvel impératif stratégique. Être mentionné par l’agent intelligent valide officiellement la crédibilité d’une marque. Cela constitue un levier de conversion indirect puissant.

L’ancien SEO de positionnement cède sa place à la valeur ajoutée. L’algorithme privilégie désormais la pertinence sémantique aux simples mots-clés. Il faut devenir une référence incontestable pour l’IA.

En fait, 200+ AI audits reveal why some industries struggle in AI search, soulignant l’importance de l’autorité. Voir ce guide sur le GEO : l’évolution incontournable du SEO.

Protocole d’analyse de la présence sur les modèles de langage

Pour comprendre comment l’IA nous perçoit, il faut appliquer une méthodologie d’audit rigoureuse basée sur des données concrètes.

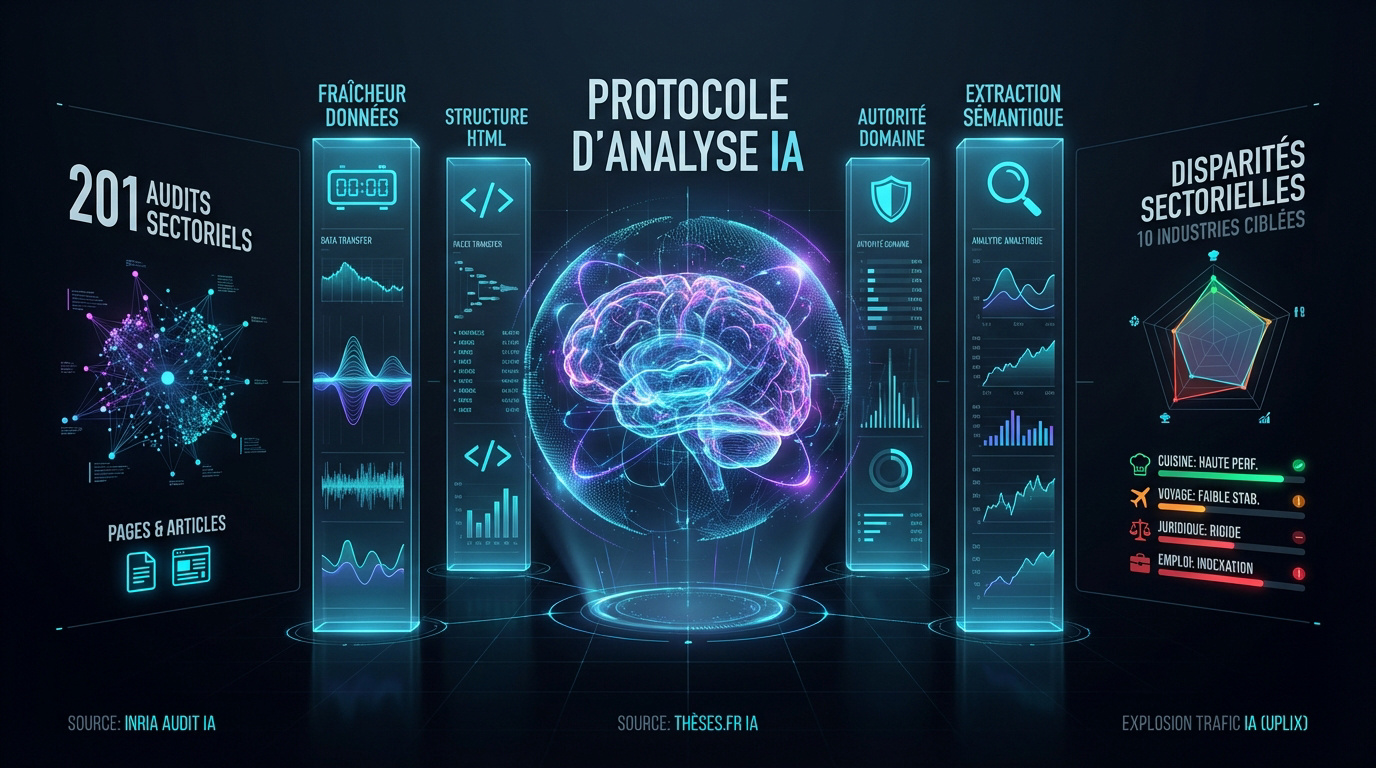

Critères de notation basés sur 201 audits sectoriels

L’analyse repose sur quatre piliers : fraîcheur, structure, autorité et extractibilité. Ces points vérifient si les modèles LLM lisent et valident le contenu. Cette approche constitue le socle de tout audit GEO. L’IA doit pouvoir valider les données.

L’étude utilise un échantillon de pages d’accueil et d’articles de fond. Ces éléments subissent une analyse technique en profondeur.

La notation s’appuie sur des points clés :

- Fraîcheur des données

- Clarté de la structure HTML

- Niveau d’autorité du domaine

- Facilité d’extraction sémantique

Consultez cet audit de l’intelligence artificielle par l’Inria pour plus de détails.

Disparités de performance entre les dix industries ciblées

Les résultats varient selon les secteurs. La cuisine performe grâce à ses données structurées. Mais le voyage chute à cause de la volatilité des prix.

Les annuaires juridiques montrent des blocages réels. Leurs structures rigides ou obsolètes freinent l’accès. Les sites d’emploi peinent aussi à être bien indexés.

Ces disparités industrielles montrent une adoption inégale. En fait, 200+ AI audits reveal why some industries struggle in AI search. On note aussi une explosion du trafic IA.

Causes techniques et théoriques de la disparition des marques

Si certaines marques disparaissent des radars, ce n’est pas par hasard. Les 200+ AI audits reveal why some industries struggle in AI search en démontrant l’impact des barrières techniques et du manque de confiance algorithmique.

Obstacles à l’extraction et échecs d’accès technique

Les barrières anti-bots bloquent souvent les agents des LLM. Ces protections trop agressives empêchent l’indexation par les moteurs conversationnels. Le JavaScript complexe reste aussi un obstacle majeur pour l’extraction de données.

Les pare-feu applicatifs (WAF) filtrent les requêtes suspectes. Ils interdisent parfois la lecture du contenu en temps réel. L’algorithme délaisse alors ces pages pour privilégier un concurrent plus accessible.

L’opacité des systèmes complique la visibilité. Les difficultés d’audit des algorithmes en boîte noire illustrent ce frein technique. Les marques perdent leur place sans comprendre ces mécanismes internes sombres.

Déficit de confiance et compression de l’information

Le manque de preuves d’autorité pénalise les sites. Sans sources sortantes ou références solides, l’IA doute de la véracité. Elle choisit de ne pas citer une entité jugée trop incertaine.

Le phénomène d’absorption transforme le web actuel. L’IA récupère l’utilité brute mais efface le créateur original. Le site devient un simple fournisseur de données non rémunéré. Cette invisibilité menace directement la survie économique des éditeurs de contenus.

Consultez ce guide pour ne pas tuer votre SEO. Cette ressource aide à maintenir une visibilité pérenne.

L’autorité ne se décrète plus par le volume de liens, mais par la validation croisée des entités nommées par les modèles.

Indicateurs de performance et correction de la perception IA

Pour reprendre le contrôle, il faut mesurer les bons indicateurs et agir sur la structure sémantique de vos actifs numériques.

Suivi de la part de voix et des mentions de marque

Le KPI « Share of Model » s’impose désormais. Cette donnée calcule votre présence réelle dans les réponses générées. Il devient le baromètre moderne de votre notoriété digitale.

Les mentions tierces valident votre légitimité. L’IA accorde sa confiance si d’autres sources parlent de vous. Le lien entre presse et visibilité IA reste frappant aujourd’hui.

Consultez ce guide pour maîtrisez la visibilité IA et affiner votre stratégie. Ces 200+ AI audits reveal why some industries struggle in AI search. Analysez ces résultats.

Rôle des données structurées dans la compréhension sémantique

L’adoption de Schema.org demeure indispensable. Ce langage universel s’adresse directement aux modèles. Il aide à identifier vos produits ou services sans aucune ambiguïté technique. La clarté sémantique facilite grandement le travail d’extraction des algorithmes actuels. Le format JSON-LD est ici privilégié.

Appliquez des techniques de remédiation précises. Rectifiez vos sources officielles si l’IA diffuse des erreurs. La fraîcheur constante du contenu constitue votre meilleure arme défensive.

Vérifiez la conformité des modèles d’IA selon la CNIL. Pour en discuter directement: Contactez-nous!. C’est une étape de sécurité.

L’analyse de ces deux cents audits prouve que l’accessibilité technique et l’autorité sémantique conditionnent votre présence dans les moteurs génératifs. L’optimisation immédiate des données structurées sécurise votre place au sein de ces flux. Maîtrisez votre visibilité algorithmique dès aujourd’hui pour dominer le paysage numérique de demain.

FAQ

Quel est l’impact des résumés génératifs sur le trafic organique ?

L’intégration de l’intelligence artificielle dans les résultats de recherche favorise l’émergence des recherches sans clic. Les utilisateurs obtiennent une réponse directe dans l’interface, ce qui réduit le taux de clics organique de 30 % à 35 % pour les requêtes informationnelles.

Cette mutation transforme le SEO traditionnel en Generative Engine Optimization (GEO). La stratégie ne repose plus uniquement sur le volume de sessions, mais sur l’autorité informationnelle et la capacité du site à être cité comme source de référence par les modèles.

Quels indicateurs permettent de mesurer la visibilité d’une marque sur l’IA ?

Le Share of Model (part de modèle) devient le nouveau KPI de référence pour évaluer la notoriété. Il mesure la fréquence d’apparition et la position d’une marque dans les réponses générées par les LLMs par rapport à ses concurrents directs.

Le taux de visibilité générée par l’IA (AIGVR) complète cette analyse en surveillant les mentions de marque sur des plateformes tierces. L’IA accorde une confiance accrue aux entités validées par des sources externes comme Reddit ou des sites de presse spécialisés.

Pourquoi certaines industries sont-elles moins visibles dans les recherches IA ?

L’audit de 201 sites révèle des disparités majeures selon les secteurs d’activité. Les sites de recettes affichent une médiane de performance de 75,0 grâce à des données structurées optimales. À l’inverse, le secteur du voyage chute à 45,5 en raison de la volatilité des prix et de la complexité technique.

Les annuaires juridiques et les sites d’emploi présentent les risques les plus élevés avec des taux d’erreur d’accès atteignant 40 %. Ces échecs résultent souvent de structures HTML rigides ou de contenus facilement compressibles par l’IA sans valeur ajoutée supplémentaire.

Quels sont les principaux obstacles techniques à l’extraction des données par l’IA ?

Les échecs d’accès concernent 18,9 %. Les barrières principales incluent les protections anti-bots agressives, les pare-feu applicatifs (WAF) et le rendu JavaScript complexe. Ces éléments empêchent les agents IA de lire le contenu de manière fiable.

Le manque de preuves d’autorité constitue un second frein majeur. L’absence d’en-têtes last modified ou la rareté des citations sortantes dégradent le score de confiance. Si l’IA ne peut justifier la fiabilité d’une source, elle préfère ne pas la citer dans sa réponse finale.

Comment optimiser un site pour favoriser sa citation par les moteurs génératifs ?

L’utilisation massive du balisage Schema.org au format JSON-LD est indispensable pour la compréhension sémantique. Une structure HTML claire avec des listes courtes et des paragraphes concis facilite l’extraction des données par les algorithmes.

La fraîcheur du contenu et la profondeur des informations traitées renforcent le score d’autorité. Un site doit proposer une utilité brute qui dépasse la simple réponse textuelle, incitant ainsi l’IA à diriger l’utilisateur vers le service ou le produit original.