L’essentiel à retenir : Google développe un nouveau contrôle d’opt-out spécifique pour permettre aux éditeurs d’exclure leurs contenus des AI Overviews sans perdre leur indexation classique. Cette mise à jour technique répond aux exigences d’équité de la CMA et à la directive européenne 2019/790. Ce mécanisme protège le trafic organique et la valeur ajoutée des sites face au scraping des LLMs. Pour en discuter directement: Contactez- nous!

Craignez-vous de voir vos contenus alimenter des résumés automatisés sans générer la moindre visite ? Google prépare une option spécifique pour exclure vos pages des résultats IA dans Search tout en maintenant leur indexation classique. Ce nouveau levier de contrôle permet aux éditeurs de protéger leur valeur ajoutée face aux AI Overviews grâce à des protocoles techniques comme le standard TDM.

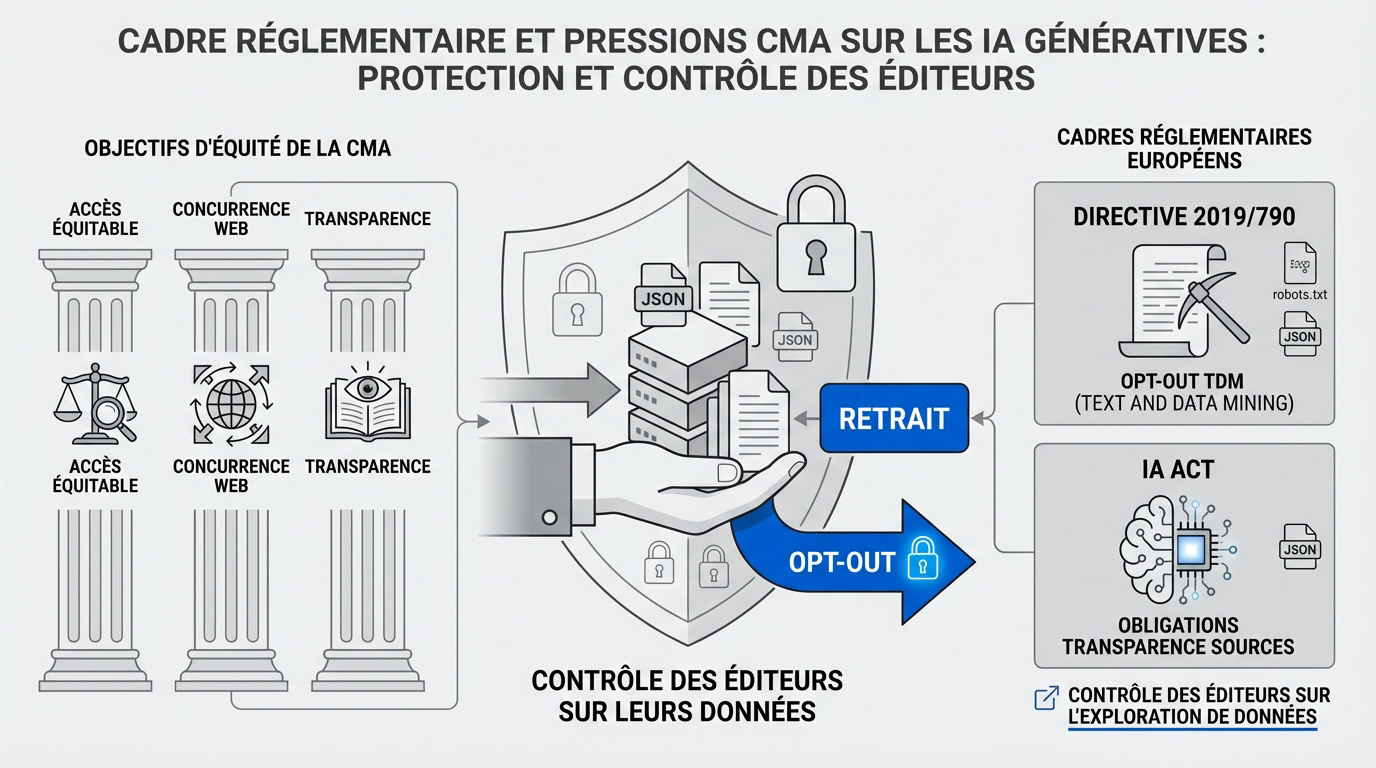

Cadre réglementaire et pressions de la CMA

L’essor des IA génératives pousse les régulateurs à intervenir pour que les éditeurs reprennent le contrôle sur leurs données numériques. Google prépare une option pour exclure son contenu des résultats IA dans Search afin de répondre à ces nouvelles exigences de transparence.

Objectifs d’équité de l’autorité britannique

La CMA impose trois piliers majeurs pour réguler le web. Elle exige l’équité des résultats, le libre choix des services et un contrôle accru des éditeurs sur leurs données.

Les propriétaires de sites redoutent une captation de valeur par les LLMs. Ils craignent de perdre leur trafic sans recevoir de contrepartie économique directe.

La pression monte. Les autorités réclament des mécanismes de retrait simplifiés et efficaces.

Directive 2019/790 et cadre de l’IA Act

La directive européenne instaure l’opt-out TDM pour l’exploration de données. Ce dispositif permet aux titulaires de droits de réserver l’usage de leurs œuvres numériques.

L’IA Act impose désormais aux fournisseurs de modèles de fondation une transparence totale. Ils doivent lister précisément les sources d’entraînement utilisées pour leurs systèmes.

Le contrôle des éditeurs sur l’exploration de données garantit ainsi le respect des droits de propriété. La protection des contenus devient une priorité technique.

Nouveaux contrôles d’exclusion contenu ia

Après avoir posé le cadre légal, il est temps d’observer comment les géants de la recherche, Google en tête, adaptent leurs outils techniques.

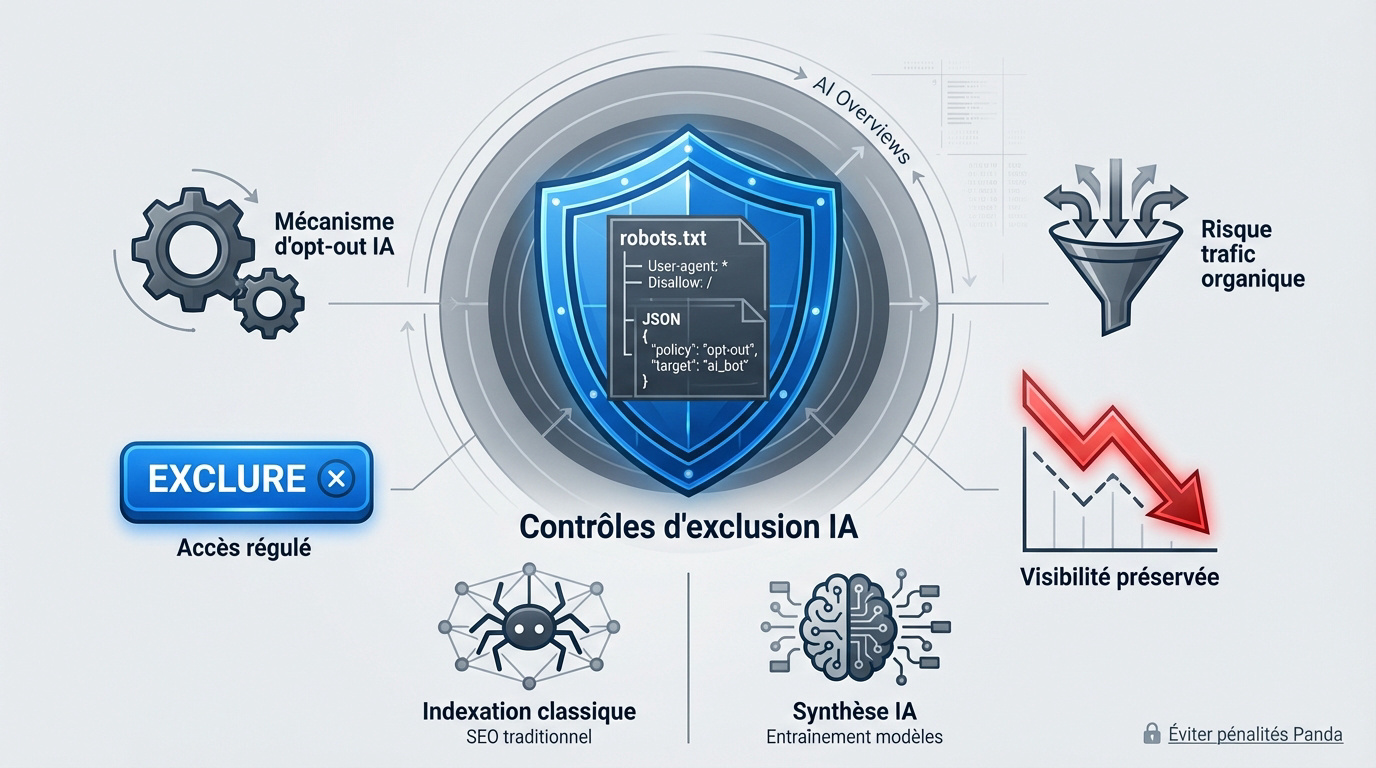

Mécanisme d’opt-out spécifique aux AI Overviews

Google développe une option inédite pour les éditeurs. Ce contrôle permet d’exclure un site des résumés générés par l’IA. Le dispositif cible spécifiquement les fonctionnalités de recherche générative.

Les AI Overviews affichent des sources citées. Pourtant, l’absence de clics directs menace sérieusement les revenus publicitaires des sites médias.

Utiliser un bouclier inédit contre les IA protège votre trafic. Le choix reste final.

Distinction entre indexation et synthèse générative

La séparation technique devient une priorité absolue. Googlebot indexe pour le classement classique. D’autres robots gèrent désormais l’apprentissage des modèles de langage.

Ce choix granulaire préserve la visibilité SEO. Les éditeurs conservent leur présence dans les résultats standards sans alimenter les réponses autonomes.

Évitez les pénalités Google Panda en soignant la valeur ajoutée. La qualité prime.

Protocoles techniques et équité du signalement

La mise en œuvre de ces exclusions repose sur des standards techniques précis que chaque webmaster doit maîtriser pour être entendu.

Standard TDM et fichiers tdmrep.json

Le protocole TDMRep utilise des signaux lisibles par machine pour exprimer la réservation des droits. Le fichier tdmrep.json, placé dans le répertoire /.well-known, centralise les autorisations au niveau du domaine. Cette méthode s’avère plus robuste que les balises meta classiques.

Le format JSON offre des bénéfices concrets pour les éditeurs :

- Centralisation simplifiée des droits numériques.

- Lisibilité optimale par les crawlers.

- Standardisation conforme à la directive européenne.

Balisage robots.txt face au scraping agressif

L’efficacité du robots.txt diminue face aux bots RAG de modèles comme Anthropic ou Perplexity. Ces robots ignorent souvent les directives classiques pour extraire du contenu en temps réel. Le ratio de scraping dépasse parfois largement les visites humaines réelles.

La protection des fichiers non textuels nécessite des métadonnées spécifiques. L’intégration de propriétés tdm:reservation dans le XMP des PDF ou les paquets EPUB renforce le contrôle sur ces ressources.

Il est possible de résoudre les problèmes de robots.txt pour limiter les accès abusifs. Google prépare une option pour exclure son contenu des résultats IA dans Search afin de compléter ces dispositifs.

Alternatives UX et commutateurs de recherche

Au-delà du code, l’expérience utilisateur et la maintenance régulière des signaux sont les derniers remparts d’une stratégie de protection efficace.

Gestion des choix par défaut sur Android

Google propose l’intégration d’un commutateur global dans les paramètres Android. Cette option permet de refuser la synthèse IA par défaut. L’utilisateur garde ainsi un contrôle permanent sur son interface.

Cette approche par switch évite les écrans de sélection répétitifs. Ces interruptions dégradent l’expérience de navigation mobile actuelle. La fluidité du parcours utilisateur est ainsi préservée.

Le choix de l’utilisateur doit être respecté sans créer de friction inutile lors de la navigation quotidienne sur smartphone.

Stratégies d’audit et protection des médias

Un audit régulier des signaux d’exclusion est nécessaire. Il permet de vérifier le respect des directives techniques par les robots. Ce contrôle assure la fiabilité de votre stratégie SEO.

La gestion de crise anticipe le traitement des contenus déjà aspirés. La non-rétroactivité des modèles LLM complique la suppression des données. Une vigilance constante limite ces risques d’exploitation non consentie.

Pour en discuter directement: Contactez- nous!.

Maîtriser ces nouveaux contrôles d’exclusion garantit la protection de votre valeur ajoutée face aux synthèses IA. En configurant dès maintenant vos signaux TDM et fichiers JSON, vous préservez votre trafic organique futur. Agissez rapidement pour transformer cette contrainte réglementaire en un levier stratégique de visibilité durable.