L’essentiel à retenir : l’essor des moteurs de réponse et du GEO redéfinit la visibilité numérique. Le trafic organique chute car 92 % des utilisateurs de Google AI Overviews ne cliquent sur aucun lien. Cette concentration favorise une minorité de domaines, tandis que l’IA agentique impose des écosystèmes fermés. Pour en discuter directement: Contactez- nous!

Votre site subit-il une perte de visibilité invisible face aux moteurs de réponse ? Le dernier rapport Arcep de janvier 2026 révèle que le GEO remplace désormais le référencement classique, avec seulement 8 % de clics sur les sources externes dans les AI Overviews. Ce contenu analyse les stratégies techniques comme le protocole ai.txt et les nouveaux standards de citation pour garantir votre survie numérique dans un écosystème où 2 % des domaines captent la moitié du trafic.

Ajustement de la visibilité du site pour l’IA

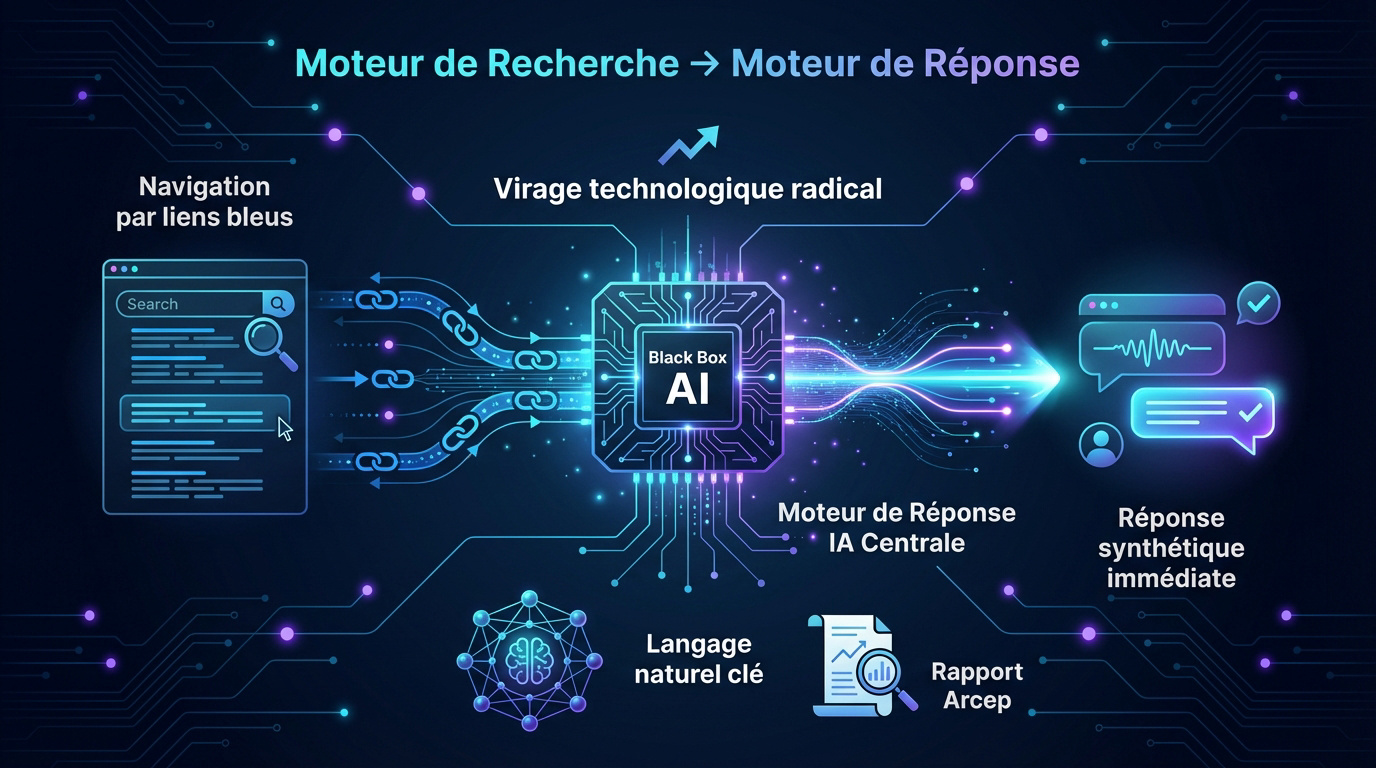

Après des années de domination du Search classique, nous basculons dans une ère où l’algorithme ne se contente plus de lister, il répond.

Transition du moteur de recherche au moteur de réponse

Le web abandonne progressivement la navigation par liens bleus. Les systèmes actuels privilégient une réponse synthétique globale. L’utilisateur ne cherche plus une page, il veut une solution immédiate.

Les usages glissent massivement vers les assistants conversationnels. Le rapport Arcep de janvier 2026 confirme cette évolution des comportements numériques. Le langage naturel remplace désormais les mots-clés hachés traditionnels.

Consultez notre analyse pour comprendre pourquoi Google Search reste dominant face aux recherches par IA malgré ces changements structurels majeurs.

Cette mutation technologique est fulgurante. C’est un virage radical pour l’internet.

Différences entre référencement classique et stratégies GEO

Les LLMs ignorent les critères traditionnels comme les backlinks classiques. Ils privilégient désormais la structure logique des données. L’IA favorise la clarté sémantique et la pertinence directe.

Le Generative Engine Optimization (GEO) impose de nouvelles règles techniques. Il faut optimiser les contenus pour l’extraction de données brute. La précision des entités devient le pilier central.

Le GEO n’est pas une option, c’est la nouvelle grammaire de la visibilité web pour quiconque veut exister demain.

Il est crucial de distinguer SEO et GEO : quelles différences réelles impactent votre stratégie de contenu actuelle.

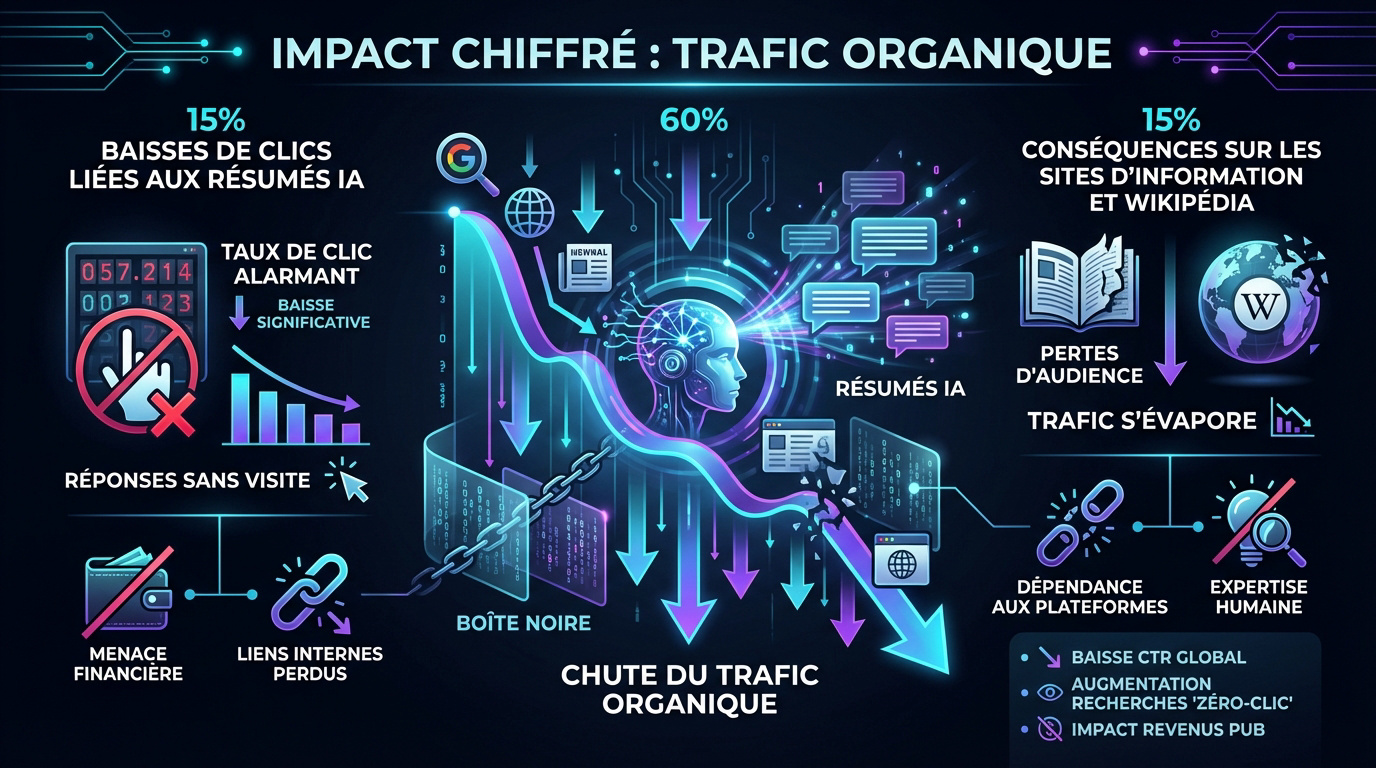

Impact chiffré sur les performances et le trafic organique

Cette mutation n’est pas sans douleur, et les premiers rapports d’audience montrent déjà des cicatrices profondes sur le trafic organique.

Analyse des baisses de clics liées aux résumés IA

L’étude du Pew Research Center révèle des statistiques alarmantes sur les AI Overviews. Le taux de clic s’effondre drastiquement. Les internautes trouvent leur réponse directement dans l’interface. Ils ne visitent plus le site source initial.

Cette rétention d’audience par les moteurs menace la survie financière des éditeurs. Le modèle publicitaire classique s’effrite rapidement. Un cercle vicieux dangereux s’installe pour l’écosystème numérique.

Comprendre le CTR ChatGPT : pourquoi vos liens ne sont jamais cliqués devient donc indispensable. L’optimisation doit désormais intégrer ces nouveaux comportements de consommation immédiate.

- Baisse du CTR global

- Augmentation des recherches ‘zéro-clic’

- Impact sur les revenus publicitaires

Conséquences sur les sites d’information et Wikipédia

La fondation Wikimédia enregistre des pertes d’audience significatives. Même ce géant du savoir subit l’intégration des fonctions génératives. Le trafic s’évapore au profit des interfaces de réponses directes.

Les sites de niche observent une baisse continue de leur fréquentation. L’actualité chaude est désormais résumée en quelques lignes par l’IA. Les petits éditeurs perdent ainsi leur principal levier de croissance organique.

La dépendance aux plateformes devient un piège. Il faut réagir vite pour exister.

L’expertise humaine reste l’unique rempart contre cette tendance à la simplification outrancière des contenus.

Concentration des sources et biais de distribution

Si le trafic baisse, c’est aussi parce que l’IA fait des choix radicaux, resserrant l’entonnoir de visibilité sur une poignée d’élus.

Domination d’une minorité de domaines dans les citations

L’étude IMPACTIA révèle une concentration extrême. Seuls 2 % des domaines captent 49 % des 200 000 citations analysées. Cette statistique illustre une oligarchie de l’information numérique sans précédent. Le pluralisme du web semble ici s’effacer.

Des sources comme Wikipédia ou Studysmarter dominent largement les réponses. L’IA privilégie systématiquement la structure la plus consensuelle. Les sources d’autorité écrasent ainsi les voix originales ou de niche. La diversité s’en trouve mécaniquement réduite.

[Étude] Comment l’IA transforme votre visibilité. Voici l’enjeu actuel.

Cette uniformisation pose question sur la diversité du web. Le pluralisme est réellement en jeu aujourd’hui.

Variabilité des résultats entre Mistral, Gemini et Perplexity

L’Arcep souligne des disparités majeures selon les modèles utilisés. Chaque IA possède ses propres favoris. Mistral ne cite pas les mêmes sources que Gemini. Cette sélection varie fortement d’un outil à l’autre.

L’opacité des algorithmes de sélection reste totale. Personne ne connaît la pondération effectuée en coulisses par les développeurs. C’est une boîte noire qui décide désormais de votre existence numérique. Les critères ne sont pas standardisés.

Un bon classement Google ne garantit rien. Pour comprendre ce décalage, consultez ce classement Google vs visibilité dans ChatGPT. La logique de citation diffère totalement du SEO classique.

L’opacité algorithmique des agents conversationnels est le nouveau défi majeur pour la transparence de l’information.

Gestion technique des crawlers et nouveaux protocoles

Face à ce pillage de données, les webmasters tentent de reprendre le contrôle via des barrières techniques plus musclées.

Limites du fichier robots.txt face aux bots d’IA

L’augmentation massive du trafic des robots d’indexation épuise les ressources. La saturation des serveurs devient critique. Certains sites deviennent inaccessibles à cause de ce scraping agressif. Les infrastructures techniques ne supportent plus cette charge constante.

Le protocole actuel est devenu obsolète pour gérer les besoins spécifiques de l’IA. Il ne peut pas distinguer l’entraînement des modèles de l’indexation classique. Cette confusion empêche un contrôle précis des accès automatisés.

Cette situation engendre des défis techniques du scraping agressif majeurs. Les protocoles historiques s’effritent.

Des systèmes comme Anubis tentent de protéger les infrastructures contre ces assauts répétés. Ils renforcent la sécurité des serveurs face aux collectes massives.

Solutions émergentes entre ai.txt et paiement par crawl

Le projet ai.txt propose un nouveau standard. Il permet de préciser les conditions d’usage des données. Ce fichier offre une granularité que le robots.txt n’a jamais possédée.

Le modèle pay-per-crawl de Cloudflare utilise le code HTTP 402. Cette méthode permet enfin de monétiser l’accès aux bots. C’est la fin du buffet gratuit pour les LLM. Les éditeurs reprennent la main financièrement.

Certains administrateurs explorent aussi le mécanisme de Proof-of-Work pour scrapers. Cela impose un coût computationnel aux robots demandeurs.

- Standard ai.txt

- Code HTTP 402

- Identification des navigateurs headless

Prospective sur l’IA agentique et les partenariats

Demain, l’IA ne se contentera plus de répondre, elle agira pour nous, verrouillant encore un peu plus l’accès au marché.

Risques du référencement fermé et accords exclusifs

Il faut anticiper l’essor des agents autonomes. Ces programmes réaliseront des achats sans validation humaine. La visibilité se déplacera vers des écosystèmes opaques. Le choix de l’algorithme remplacera celui de l’internaute.

OpenAI collabore déjà avec des leaders comme Walmart. Ces partenariats stratégiques verrouillent les accès. Ils dressent des barrières insurmontables pour les petits éditeurs. Le commerce devient une affaire de contrats privés.

Plus d’informations sur La stratégie IA de Google en 2025.

Le web ouvert s’efface devant des réseaux fermés. Les accords commerciaux dictent désormais la visibilité numérique.

Méthodes de test de visibilité de marque dans les LLM

L’expert doit mettre en place des protocoles manuels. Soumettez vos requêtes de marque à ChatGPT ou Claude. Vérifiez si vos pages servent de sources. Notez si l’IA vous cite ou vous ignore.

Les secteurs de niche offrent de réelles opportunités. Les LLMs manquent souvent de précision sur les sujets pointus. Votre expertise technique permet de combler ces lacunes. C’est ici que l’humain garde l’avantage.

Consultez notre offre de GEO Audit de recherche IA.

Agissez dès maintenant. Ne subissez pas la chute brutale de vos courbes d’audience.

Ressources pour améliorer votre présence numérique

Pour ne pas disparaître, il faut dès aujourd’hui muscler son infrastructure et s’entourer des bons outils.

Audit technique et structuration des données Schema.org

Les services d’audit permettent l’ajustement aux moteurs IA. La configuration des données structurées est votre bouée de sauvetage. Elle permet aux machines de comprendre votre contexte. L’outil de test des résultats enrichis de Google signale alors les erreurs critiques.

La rédaction doit évoluer pour devenir plus factuelle et structurée. Les formations sur le SEO programmatique enseignent l’usage d’outils no-code. Apprenez à parler aux algorithmes. Automatisez la création de pages pour couvrir efficacement la longue traîne.

Pour en discuter directement: Contactez- nous!

Consultez notre guide : SEO à l’ère de l’IA : fondamentaux.

C’est une base indispensable.

Engagement communautaire et suivi des rapports Arcep

L’échange en section commentaires favorise l’apprentissage collectif. Comment gérez-vous l’adoption de formats IA-friendly ? Vos retours d’expérience sont précieux pour toute la communauté. Partagez vos doutes sur l’opacité des citations.

L’inscription à la newsletter permet de rester informé des dernières études. Suivre les évolutions réglementaires de l’internet ouvert est vital. Ne restez pas isolés face à ces changements technologiques majeurs. Le rapport Arcep 2026 souligne ces urgences.

La survie du web indépendant dépend de notre capacité à partager nos stratégies face à l’hégémonie de l’IA.

- Inscription newsletter

- Section commentaires

- Rapports Arcep trimestriels

Le rapport Arcep 2026 confirme l’urgence d’adopter le Generative Engine Optimization pour contrer la chute du trafic organique. Maîtriser ses données structurées et ses protocoles de crawl devient vital pour rester visible face aux agents conversationnels. Agissez dès maintenant pour garantir la survie de votre autorité numérique dans ce nouvel écosystème algorithmique.

FAQ

Pourquoi un bon classement sur Google ne garantit plus ma visibilité dans l’IA ?

Le rapport de l’Arcep de janvier 2026 indique que les critères de sélection des IA diffèrent du SEO classique. L’étude IMPACTIA montre que le taux d’intersection entre les citations des IA et le top 5 de Google varie seulement de 19 % à 32 %.

Les modèles de langage comme Mistral, Gemini ou Perplexity privilégient la structure logique et la clarté sémantique plutôt que les seuls backlinks. Un site bien positionné sur les moteurs de recherche peut donc être totalement ignoré par les résumés génératifs.

Quel est l’impact réel des résumés IA sur le trafic des sites web ?

La généralisation des réponses directes provoque une baisse critique du trafic organique. Selon le Pew Research Center, les utilisateurs exposés aux Google AI Overviews ne cliquent vers une source externe que dans 8 % des cas.

Cette tendance favorise les recherches « zéro-clic », où l’internaute obtient sa solution sans visiter le site d’origine. Même des géants comme Wikipédia constatent une chute de leur audience suite à l’intégration de ces fonctions génératives.

Qu’est-ce que le GEO et comment l’utiliser pour mon site ?

Le Generative Engine Optimization (GEO) est la nouvelle discipline visant à optimiser les contenus pour les moteurs de réponse. L’objectif est de devenir une source citée par les agents conversationnels en soignant la précision des entités nommées.

Pour exister dans ce nouvel écosystème, les éditeurs doivent adopter des formats « IA-friendly ». Cela passe par une structuration rigoureuse des données via Schema.org et une rédaction plus factuelle facilitant l’extraction d’informations par les LLM.

Comment protéger mon contenu contre le scraping agressif des IA ?

Le fichier robots.txt traditionnel devient insuffisant car il ne distingue pas toujours l’entraînement des modèles de l’indexation classique. Certains crawlers d’IA saturent les serveurs, représentant parfois 65 % du trafic comme chez Wikimédia.

Des solutions comme le protocole ai.txt permettent de définir des conditions d’usage plus granulaires. Cloudflare propose également un modèle « pay-per-crawl » via le code HTTP 402 pour monétiser l’accès des robots aux données du site.

Quels sont les risques liés à l’émergence de l’IA agentique ?

L’IA agentique agit au nom de l’utilisateur pour effectuer des achats ou des réservations, créant une couche d’intermédiation opaque. Ce système favorise un « référencement fermé » basé sur des accords commerciaux exclusifs entre les développeurs d’IA et de grandes plateformes.

Les acteurs n’ayant pas de partenariats directs, comme ceux signés par OpenAI avec Walmart ou Anthropic avec Canva, risquent d’être exclus des suggestions. Le web ouvert pourrait ainsi se transformer en un réseau de contrats privés et d’écosystèmes verrouillés.

Comment vérifier si ma marque est citée par les principaux modèles d’IA ?

Il est nécessaire de mettre en place des protocoles de vérification manuelle en testant directement des requêtes de marque dans ChatGPT, Claude ou Perplexity. L’observation des sources citées permet d’identifier si votre expertise est reconnue ou ignorée.

L’étude IMPACTIA révèle une forte concentration : 2 % des domaines captent 49 % des citations. Si votre site n’apparaît pas, un audit technique axé sur le GEO et la structuration des données est indispensable pour corriger ce déficit de visibilité.