L’essentiel à retenir : l’assistant IA agit comme un copilote technique amplifiant la productivité, mais ne remplace pas le jugement humain. Comprendre cette distinction permet de déléguer l’exécution opérationnelle aux LLM tout en gardant la main sur la stratégie et la qualité E-E-A-T. L’analogie « Iron Man » résume cette approche : une puissance technologique pilotée par une intention humaine.

Considérer à tort une ia copilote comme un substitut autonome expose les entreprises à des risques de fiabilité et à une perte de contrôle stratégique. Cette étude technique délimite les capacités réelles des LLM pour distinguer l’exécution automatisée de la prise de décision humaine indispensable en SEO. Une intégration lucide de ces outils transforme les flux de travail et sécurise la qualité des livrables face aux limites contextuelles des algorithmes.

L’assistant IA, un copilote et non un pilote automatique

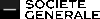

Le concept de copilote IA : plus qu’un simple chatbot

L’ia copilote se définit comme un assistant technique intégré directement aux flux de travail. Il ne constitue pas une entité conversationnelle autonome. Son objectif reste l’assistance opérationnelle sur des tâches précises.

Le terme même de copilote implique une collaboration stricte. L’humain conserve le rôle de pilote, fixant le cap et validant chaque décision critique pour l’entreprise.

Cette approche tranche avec les chatbots généralistes comme ChatGPT qui répondent via une interface de discussion isolée. Un copilote, lui, opère au cœur des applications comme le traitement de texte ou l’IDE. Il agit sur la matière même du travail.

Un amplificateur de capacités, pas un substitut

L’outil vise avant tout à augmenter la productivité humaine en absorbant la charge. Il ne remplace jamais l’expertise métier ni le jugement. Il gère les tâches répétitives ou complexes.

Voyez-le comme un outil qui démultiplie la force ou la vitesse d’exécution. L’opérateur humain fournit l’intention et la direction stratégique. La machine apporte la puissance de calcul brute.

La finalité consiste à libérer des heures précieuses pour se concentrer sur des missions à haute valeur ajoutée. La réflexion stratégique demeure une prérogative exclusivement humaine. L’IA exécute, le cerveau décide.

Des exemples concrets, de Microsoft à la programmation

Microsoft Copilot illustre cette dynamique par son intégration profonde dans la suite Office 365. Il aide à rédiger des emails, synthétiser des documents ou créer des présentations. L’utilisateur garde la main sur le ton et le contenu final.

GitHub Copilot suggère des lignes de code ou des fonctions entières aux développeurs. Il permet d’accélérer le développement technique sans remplacer l’architecte logiciel. La logique structurelle reste la responsabilité du codeur.

L’intégration dans les moteurs de recherche comme Bing marque aussi cette évolution, où l’IA assiste la recherche d’information. Elle trie les données pour offrir une réponse synthétisée.

Ce qui distingue vraiment un copilote d’une IA généraliste

Voici les marqueurs techniques qui séparent un véritable assistant intégré d’un simple générateur de texte.

- Contexte applicatif : Le copilote a accès au contexte de l’application, tel que le document ouvert ou le code en cours, contrairement à un chatbot qui part de zéro.

- Finalité de l’action : Le copilote vise à produire une action concrète, comme insérer un tableau ou écrire une fonction, pas seulement à fournir une réponse textuelle.

- Niveau d’intégration : Il est nativement intégré dans l’interface utilisateur, agissant comme une fonctionnalité supplémentaire du logiciel pour fluidifier le travail sans changer de fenêtre.

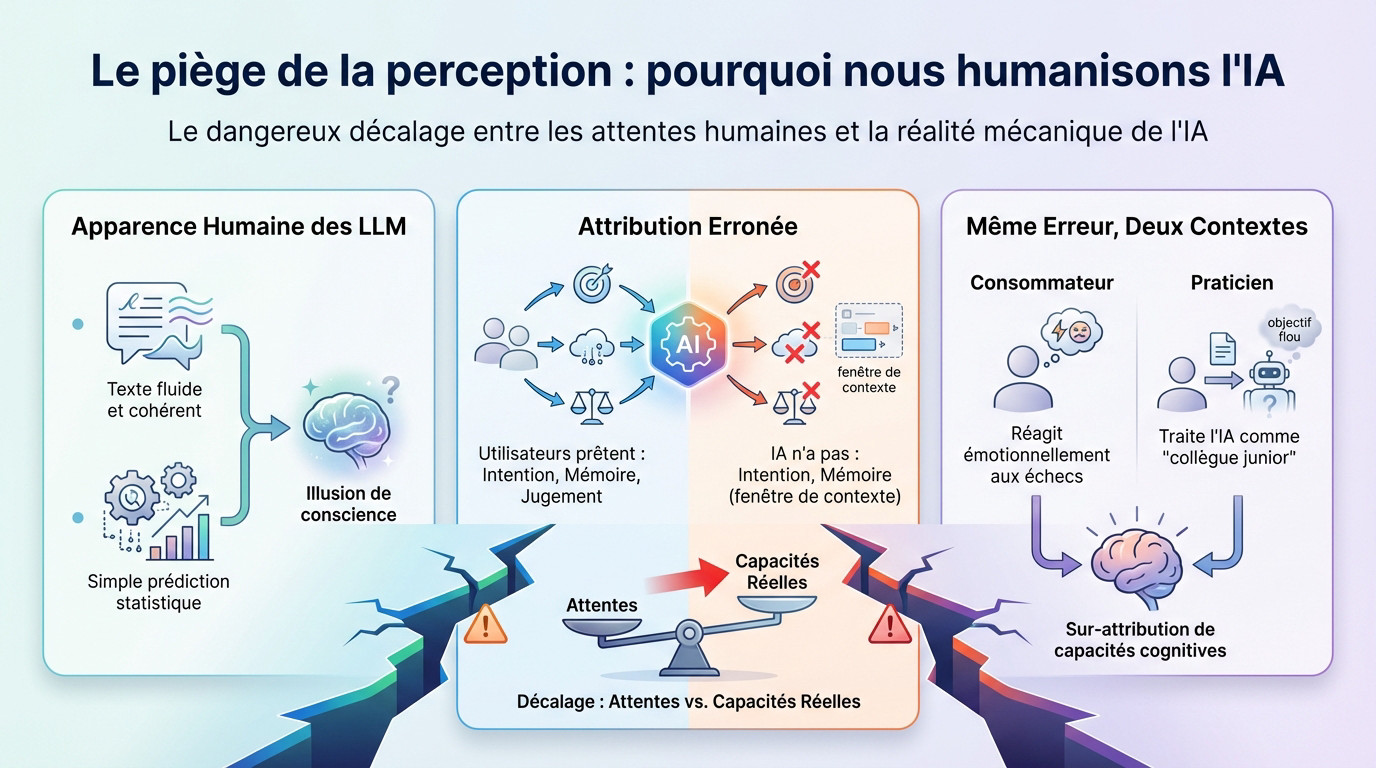

Le piège de la perception : pourquoi nous humanisons l’IA

La fluidité des LLM, une apparence dangereusement humaine

Les grands modèles de langage (LLM) excellent dans l’art de la mimétique linguistique. Leur aptitude à produire un texte fluide et cohérent masque leur véritable nature : une mécanique probabiliste de prédiction du mot suivant. Ils ne réfléchissent pas ; ils calculent statistiquement la suite logique d’une phrase.

Cette prouesse technique leurre notre cerveau et fausse notre jugement. L’utilisateur construit alors des « « modèles mentaux » erronés, projetant une compréhension humaine sur ce qui n’est qu’un algorithme de décodage sophistiqué.

Ce gouffre entre la surface polie de l’outil et sa réalité mathématique engendre les principales confusions actuelles sur l’intelligence artificielle.

L’attribution erronée d’intention, de mémoire et de jugement

L’humain a ce réflexe tenace de voir de l’esprit là où il n’y a que du code. On suppose une intention cachée derrière une réponse, une mémoire relationnelle ou une faculté de jugement éthique similaire à la nôtre.

Or, un LLM reste sourd au sens profond et n’infère rien d’une demande vague. Il opère comme une ia copilote technique dont la « mémoire » se limite strictement à une fenêtre de contexte, sans aucune continuité réelle entre les sessions.

La fluidité conversationnelle des LLM nous pousse à leur prêter un jugement qu’ils ne possèdent pas, créant un décalage dangereux entre nos attentes et leurs réelles capacités.

Consommateurs et praticiens : deux usages, une même erreur

Le grand public dialogue souvent avec ces interfaces comme avec un proche. Il s’agace, réagit émotionnellement aux échecs de la machine et se sent personnellement incompris lorsque la réponse tombe à côté de la plaque.

En entreprise, le spécialiste marketing commet une faute similaire en considérant l’outil comme un « collègue junior » autonome. Il délègue sans cadrage précis, espérant que l’algorithme devine la stratégie. L’usage de l’IA en entreprise révèle souvent ce type de méprise coûteuse.

Dans les deux scénarios, l’erreur est symétrique : une sur-attribution massive de capacités cognitives à un système qui en est totalement dépourvu.

« Iron Man, pas Superman » : l’analogie pour bien utiliser l’IA

Superman : l’attente d’une IA autonome et omnisciente

Superman incarne le mythe d’une technologie parfaite qui règle tout sans effort. On imagine une entité capable de comprendre seule les problèmes complexes et de les résoudre instantanément. C’est l’erreur classique.

La science-fiction a ancré cette vision d’un sauveur numérique dans l’imaginaire collectif. Beaucoup d’entreprises espèrent secrètement que l’outil fera le travail à leur place.

Cette attente provoque inévitablement de la frustration face aux erreurs des LLM. L’ia copilote actuelle n’a rien d’un super-héros invulnérable.

Iron Man : l’humain aux commandes d’un outil surpuissant

L’analogie d’Iron Man corrige cette perception faussée. Tony Stark reste le génie créatif qui pilote l’armure. La machine amplifie simplement ses capacités physiques et intellectuelles, mais c’est l’homme qui tranche. Sans pilote, le costume reste inerte.

L’IA traite les données et suggère des itinéraires à une vitesse fulgurante. Pourtant, elle ne définit jamais la destination ni l’urgence de la mission.

Ce modèle mental replace l’utilisateur au centre du processus décisionnel. L’humain garde le contrôle, tandis que l’interface décuple sa puissance de production.

Exécution d’ordres contre prise de décision stratégique

Il faut distinguer la capacité de production de la faculté de jugement. L’IA excelle dans l’exécution rapide de tâches répétitives ou volumineuses.

La prise de décision exige une compréhension fine du contexte commercial et des nuances humaines. Un algorithme ne saisit pas les enjeux politiques ou les risques d’image subtils. Il calcule, il ne pense pas.

« L’IA est un exécutant formidable, mais un très mauvais décideur. Confondre ces deux rôles est la plus grande erreur stratégique que l’on puisse commettre aujourd’hui. »

Les contraintes, les objectifs et les valeurs restent humains

La machine opère strictement dans le périmètre que vous tracez. C’est au responsable SEO de fixer les contraintes techniques, le budget et le ton éditorial. Sans cadre précis, le résultat dérive.

Aucun modèle ne peut déterminer vos objectifs de croissance ou défendre vos valeurs éthiques. L’alignement avec l’image de marque relève de la compétence humaine. Déléguer cette responsabilité morale expose l’entreprise à des dérapages incontrôlables.

Applications concrètes pour les leaders SEO et marketing

Accélérer la recherche de mots-clés et l’analyse de SERP

Traiter manuellement des milliers de lignes Excel est une perte de ressources. Une ia copilote digère ces volumes massifs pour grouper des mots-clés par intention réelle. Elle repère les questions fréquentes et les thématiques connexes que l’œil humain rate souvent.

Côté analyse, l’outil ne se contente pas de lister des liens. Il permet de synthétiser les angles éditoriaux de vos concurrents. L’IA isole les types de contenus performants et identifie les « features » spécifiques, comme les PAA ou les featured snippets, à cibler immédiatement.

Expansion de contenu et détection de schémas

Partir d’une feuille blanche coûte cher en temps de cerveau. L’IA transforme un simple plan en une ébauche exploitable en quelques secondes. C’est un levier technique puissant pour l’expansion de contenu, éliminant la friction du démarrage.

Mais la supervision reste obligatoire. Savoir comment guider la génération de contenu IA pour le SEO est une compétence clé, où l’humain fournit le brief et l’IA se charge de la rédaction initiale.

Au-delà de l’écriture, l’algorithme scanne l’architecture du site pour détecter des schémas invisibles. Il signale les pages orphelines, les failles dans le maillage interne ou les opportunités sémantiques manquées qui diluent votre autorité.

Les tâches où l’IA excelle (et celles à ne pas lui confier)

La machine bat l’humain sur la vitesse et le volume de traitement, c’est indiscutable. Voici où elle gagne :

- Synthèse et résumé : Condenser de longs rapports ou des analyses de concurrents.

- Génération de variations : Créer plusieurs titres, méta-descriptions ou accroches publicitaires à partir d’une idée.

- Correction et reformulation : Améliorer la grammaire et le style d’un texte existant.

- Extraction de données : Repérer et lister des entités, des chiffres ou des faits dans un corpus de textes.

Ce que l’IA ne peut pas décider : autorité, pertinence et succès

Un algorithme ne ressent pas la nuance de la crédibilité. L’IA ne comprend pas le concept d’autorité (E-E-A-T). Elle est incapable de décider quelle source possède l’expertise réelle ou quel argument pèse le plus lourd dans votre secteur.

Elle échoue aussi à évaluer la pertinence finale pour une audience de niche. Elle ne peut pas faire de compromis stratégiques entre volume et conversion. Définir ce qu’est le succès reste une responsabilité purement humaine.

Les risques d’une confiance aveugle et les limites de l’autonomie

Le danger de déléguer la pensée stratégique

Le risque le plus grave est de traiter l’IA comme un décideur stratégique. Lui demander « quelle devrait être notre stratégie de contenu ? » est une erreur fondamentale. Cela revient à abandonner sa responsabilité. Vous perdez le contrôle du navire et votre avantage concurrentiel s’effondre immédiatement.

Une IA peut générer une stratégie qui semble cohérente, mais elle sera dépourvue de vision, de différenciation et de compréhension du marché. C’est une stratégie générique, donc inefficace. Elle ne connaît pas vos clients ni vos enjeux réels. Votre marque devient alors invisible et interchangeable.

Biais, hallucinations et manque de fiabilité contextuelle

Rappelez-vous que les IA reproduisent les biais présents dans leurs données d’entraînement massives. Leurs résultats peuvent être discriminatoires, sexistes ou simplement erronés. C’est un miroir déformant de la réalité. Ignorer ce fait expose votre entreprise à des bad buzz évitables et destructeurs.

Attention au phénomène fréquent des « hallucinations ». L’IA peut inventer des faits, des sources ou des chiffres avec une assurance totale et effrayante. La vérification est impérative. Une donnée fausse publiée sur votre site ruine votre crédibilité d’expert en quelques secondes seulement.

Soulignons le manque de fiabilité contextuelle. Une ia copilote peut appliquer une information technique correcte dans un mauvais contexte, menant à des conclusions absurdes ou dangereuses pour une marque. Le discernement reste humain. La machine ne comprend pas les nuances culturelles ou émotionnelles.

Quand le « collègue junior » produit du contenu de mauvaise qualité

Reprenons l’analogie du « collègue junior ». Sans un brief précis et une supervision constante, il produira un travail médiocre et sans âme. Il en va de même pour l’IA. Elle exécute, mais elle ne pense pas par elle-même. Vous devez guider chaque étape du processus.

Publier du contenu IA non supervisé est risqué, car Google se méfie des contenus de faible qualité, qu’ils soient générés par IA ou non. La validation humaine est un filtre de qualité indispensable. Ne jouez pas avec votre référencement, les pénalités algorithmiques sont souvent sévères et difficiles à remonter.

Reprendre le contrôle : la nouvelle répartition des tâches

Recentrer la « propriété de la pensée » sur l’humain

La correction essentielle est de réaffirmer la « propriété de la pensée ». C’est à l’humain de définir le « pourquoi » et le « quoi » de chaque projet. L’IA s’occupe ensuite du « comment » à grande échelle.

Cela signifie que l’humain doit toujours être à l’origine de la stratégie. Il définit les objectifs, les priorités et les critères d’évaluation. L’ia copilote reste un outil au service de cette pensée, pas sa source.

Définir les rôles : le partage clair des responsabilités

Il est nécessaire de proposer une répartition claire et binaire des tâches entre l’opérateur humain et l’IA.

- Responsabilités humaines : Définition des objectifs, jugement, évaluation, prise de décision stratégique, validation finale, définition des contraintes et des valeurs.

- Tâches de l’IA (copilote) : Expansion et rédaction initiale, synthèse de données, vitesse d’exécution, détection de motifs à grande échelle, analyse brute.

Adopter le bon modèle mental pour un avantage concurrentiel

Les entreprises qui réussiront sont celles qui cesseront d’attendre de l’IA ce qu’elle n’est pas. Adopter le modèle mental du copilote est un véritable avantage concurrentiel pour les équipes marketing.

Cela permet de se concentrer sur l’amélioration des prompts, la qualité des briefs et la supervision intelligente. C’est plus rentable que de perdre du temps à être frustré par les limites de l’outil.

L’IA ne remplace pas le travail, elle le redistribue

En définitive, l’IA modifie la répartition des responsabilités au sein des organisations. Elle ne supprime pas le besoin de travail humain qualifié, elle le déplace.

Elle amplifie les capacités humaines, mais rend le jugement et la direction stratégique encore plus importants. Pour approfondir ces concepts, vous pouvez télécharger notre livre blanc sur l’IA.

L’intégration de l’IA comme copilote exige une redéfinition claire des responsabilités. Si les LLM accélèrent l’exécution technique, la stratégie et le jugement restent des prérogatives exclusivement humaines.

Maîtriser cette collaboration homme-machine constitue désormais un avantage concurrentiel décisif pour les professionnels du SEO et du marketing digital.

FAQ

Qu’est-ce qu’une intelligence artificielle de type Copilot ?

Le Copilot se définit comme un partenaire collaboratif spécialisé, intégré directement dans les flux de travail d’un utilisateur. Contrairement à un simple chatbot, il possède une connaissance contextuelle de l’environnement applicatif, qu’il s’agisse d’un IDE ou d’une suite bureautique. Son rôle consiste à assister l’humain dans des tâches complexes pour amplifier la productivité sans se substituer au décideur.

Quelle est la différence fondamentale entre ChatGPT et un Copilot ?

ChatGPT fonctionne principalement comme une interface conversationnelle généraliste, souvent déconnectée du contexte de travail immédiat. À l’inverse, un Copilot s’intègre nativement aux applications et accède aux données en temps réel pour effectuer des actions précises. Cette intégration permet au Copilot d’agir concrètement sur les fichiers ou le code, là où ChatGPT fournit essentiellement du texte brut.

Quelles sont les capacités exclusives d’un Copilot par rapport à une IA généraliste ?

Un Copilot excelle dans l’exécution d’actions contextuelles, comme la génération de lignes de code au sein d’un éditeur ou la synthèse de documents ouverts. Il analyse l’environnement spécifique de l’utilisateur pour proposer des suggestions proactives et pertinentes. Les IA généralistes, limitées aux LLM conversationnels, manquent de cette capacité d’interaction directe et profonde avec les logiciels métiers.

Quels avantages concrets offre l’utilisation d’un assistant Copilot ?

L’avantage principal réside dans l’augmentation significative de la productivité et la réduction drastique des tâches répétitives. En déléguant l’exécution technique à l’IA, l’utilisateur peut se concentrer sur la stratégie et la validation à haute valeur ajoutée. Des outils comme GitHub Copilot permettent ainsi d’accélérer les cycles de développement tout en maintenant le contrôle humain sur la structure finale.

Pourquoi une confiance aveugle en l’IA représente-t-elle un risque stratégique ?

Les modèles de langage (LLM) sont sujets aux hallucinations et reproduisent les biais cognitifs présents dans leurs données d’entraînement. L’IA ne possède ni jugement moral, ni compréhension réelle des enjeux stratégiques ou de l’autorité (E-E-A-T) d’une information. Se fier aveuglément à ses réponses sans validation humaine expose l’entreprise à des erreurs factuelles et à des contenus de faible qualité.

Microsoft Copilot est-il accessible gratuitement ?

Microsoft propose une version gratuite de Copilot accessible via le web et le navigateur Edge, offrant des fonctionnalités de conversation et de recherche basiques. Cependant, l’intégration poussée dans les applications Microsoft 365 (Word, Excel, PowerPoint) nécessite une licence commerciale spécifique. Les entreprises doivent souscrire à des plans dédiés pour bénéficier des fonctionnalités avancées de sécurité et de conformité.