Comprendre Google Penguin afin de mieux orienter ses stratégies d’optimisation

Apparu en 2012 dans la foulée de Google Panda, l’algorithme Penguin en a inquiété plus d’un. Certains ont même parlé de stratégie FUD (Fear Uncertainty and Doubt) de la part de Google afin de faire trembler les spammeurs.

En effet, sanctionnant le netlinking agressif, avec des techniques d’ancrage abusives (l’ancre étant la partie cliquable lors d’un lien) et autres technique comme le cloaking ou le spamdexing, il a contribué à revaloriser les sites de bonne qualité selon les critères de Google.

À présent qu’il fonctionne en temps réel, saisir ses mécanismes peut participer à une savante association des techniques de référencement naturel et d’une bonne expérience utilisateur. Vous verrez d’ailleurs comment éviter certaines erreurs, mais aussi quelques pratiques pour lutter contre le “negative SEO” dont vous pourriez être la cible.

2012 : Google Penguin arrive en renfort de Google Panda

Vous l’avez peut-être remarqué, mais la course au positionnement ressemble à un vaste MMORPG (Massively Multiplayer Online Role Palying Games) dans lequel s’affronte des millions de joueurs en ligne. Et plus il y a de participants, plus il y a de chances de tomber sur une faille dans les règles du jeu.

Il ne faut alors que peu de temps pour que tout le monde s’y engouffre afin d’en tirer profit. C’est ce qu’il s’est passé avec les manipulations de liens, qui ont permis à beaucoup de spams de passer entre les mailles du filet Panda.

Ainsi, l’idée derrière Penguin était de hiérarchiser la valeur des différents liens entrants d’un site internet. Pour cela, il s’agit de distinguer les liens naturels faisant autorité et les techniques de manipulation. En principe, les liens sortants sont laissés de côté.

À la fin, l’objectif est de récompenser indirectement la pertinence des sites Web. En effet, les meilleurs devraient mécaniquement faire graviter autour d’eux des liens naturels, tandis que les spams ont besoin de forcer les choses.

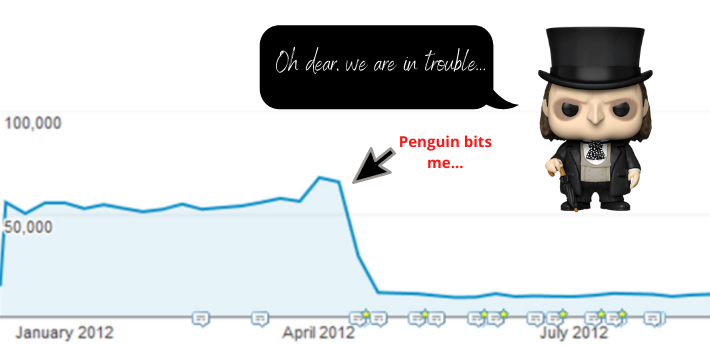

Les effets de l’algorithme Penguin

D’abord, il convient de préciser que les déclassements liés à Google Penguin n’affectent que les pages concernées. Une bonne nouvelle pour ceux qui auraient peur de recevoir du trafic depuis des liens entrants louches. Quoi qu’il en soit, Google Penguin cible les pages sur-optimisées en mots-clés et en netlinking.

Comme il ne s’agit pas d’une sanction en soi, mais plutôt d’un filtre, vous ne serez pas notifié(e) d’une perte de place dans les SERP. C’est à vous de vérifier si votre visibilité ne chute pas sans raison apparente. À ce titre, comparer avec un autre moteur de recherche tel que Bing peut parfois servir de test.

Ce que Google Penguin risque de pénaliser

D’abord, l’accumulation de mots-clés dans tous les recoins (url, balise title, méta-description et tous les niveaux de titre…) est prohibée. Idem pour le contenu même des textes, qui ne doit pas se voir constellé de mot-clés, lesquels rendent la lecture laborieuse.

D’autre part, les mauvais backlinks sur les mêmes ancres provenant de sites qui n’ont rien à voir les uns avec les autres attirent l’attention du bot. De la même manière, les achats de liens depuis des annuaires et des communiqués de presse de faible notoriété sont plus que risqués.

De plus, les foyers de liens épars, les échanges de backlinks dépourvus de cohérence logique et autres linkwheel (système de sites dédiés à la création de liens entrants via des pages satellites) sont très rapidement repérés. D’ailleurs, Google Penguin semble capable d’identifier les sites provenant du même propriétaire, autrement qu’à travers les adresses IP.

Enfin, l’algo se méfie également des redirections depuis des sites rédigés dans une tierce langue. Nota bene : l’algorithme Penguin parvient à tenir compte de l’aspect d’ensemble de vos liens. En conséquence, il sait percevoir la proportion de bons liens naturels par rapport aux liens indésirables. Ainsi, cela réduit les risques de “référencement négatif”.

La bonne conduite ? La bonne foi !

L’on parle de “liens naturels” depuis tout à l’heure, mais ce n’est pas si facile de récupérer des liens entrants. Surtout pour un site internet qui démarre !

Voilà pourquoi la sur-optimisation est souvent tentante, bien que de plus en plus contre-productive. Aussi la meilleure stratégie consiste-t-elle, à long terme, à faire grandir la notoriété de votre site Web.

Et cela passe invariablement par d’excellents contenus, une cohérence dans les thématiques, un soin apporté à l’expérience utilisateur et le cachet que peuvent apporter une rédaction solide accompagnée d’images et de vidéos qui font sens.

En résumé, comme pour Google Panda, privilégiez un bel artisanat fourni par des collaborateurs compétents. Évidemment, dans le même temps, surveillez votre netlinking : quelques bons liens valent infiniment plus que beaucoup de mauvais liens !

Les pratiques devenues obsolètes

Bon, certes, on ne peut pas vous laisser comme ça, juste avec des préceptes pétris de morale kantienne. Il y a tout de même des erreurs concrètes à ne pas commettre :

- s’insérer dans des boucles de lien de type linkwheel ;

- cacher des mots-clés ou des liens ;

- utiliser le cloaking, une technique consistant à leurrer les bots qui viennent consulter votre site web avec une page prévue à cet effet ;

- placer des redirections hors-sujet ;

- utiliser des pages satellites oudoorway page;

- proposer des contenus détournés;

- programmes d’affiliation sans valeur ajoutée pour l’utilisateur ;

- Multiplication de mots-clés ou keyward stuffing ;

- Suroptimisation des rich snippet, ou extraits enrichis balisés.

Quelle stratégie adopter après un “hit” de Google Penguin ?

Si vous devinez avoir été dans le viseur de Google Penguin, voici la démarche à suivre :

- faites un audit de vos backlinks, notamment grâce à la Search Console, afin de supprimer dès que possible tous ceux qui ne sont ni légitimes ni naturels ou qui recèlent des contenus spammy ;

- vérifiez vos ancres de liens : tout ne doit pas être optimisé de la même manière, avec les mêmes mots-clés. Depuis 2012, le bourrinage doit laisser place à la subtilité ;

- désavouez auprès de Google les backlinks que vous ne pouvez pas supprimer (ou faire supprimer), en remplissant un formulaire indiquant les liens que vous avez identifiés comme néfastes.

Plutôt supprimer ou désavouer ?

Bien sûr, on voudrait activer les leviers les plus rapides afin d’arriver à de prompts résultats. Si vous êtes vous-même à l’origine d’un mauvais backlink, qu’à cela ne tienne : il vous suffit de le retirer.

En revanche que faire lorsque vous subissez les liens entrants d’un site illégitime ?

On aurait envie de remplir le formulaire évoqué ci-dessus, et puis bon débarras ! Cependant, si vous avez consulté le lien, vous avez probablement vu le message d’avertissement de Google : n’abusez pas du désaveu. N’en faites usage qu’en dernier recours, à savoir si :

- vous êtes convaincu(e) que ces liens vous causent du tort ;

- le webmaster du site web incriminé ne répond pas à votre requête.

Vous devez donc commencer par bien analyser vos backlinks. Puis, en cas de litige, contactez les webmasters concernés pour régler la situation à l’amiable.

Et si on exige de vous des frais pour retirer un lien, Google recommande un refus catégorique. En effet, la réaction inverse encouragerait un autre marché souterrain fondé sur le chantage au mauvais backlink.

Pratique de sensibilisation sur le bon usage des backlinks

Rien de tel que l’anticipation. À ce titre, il est possible d’inclure, dans les termes et conditions de votre site web, une pratique responsable des partages de lien. Voici à quoi peut ressembler ce genre d’avertissement, dont vous pourrez vous inspirer :

“Nous vous encourageons à mettre des liens vers nos pages web, à condition que ce soit réalisé sans irrégularités de votre part. À savoir :

- si nous vous demandons de changer ou de retirer un lien de votre site web, il vous incombe de procéder dès que possible à la modification requise ;

- vous ne laisserez aucune indication laissant supposer un partenariat, une approbation ou un soutien de notre part ;

- vous devrez vous efforcer d’employer ces liens de sorte à ne pas en tirer profit au détriment de notre réputation ;

- vous ne devrez pas outrepasser la limite de dix liens vers l’une de nos pages sans avoir, au préalable, sollicité notre permission ;

- le site où vous placerez vos liens ne devra contenir aucun propos obscène, offensant ou diffamatoire, ni commettre d’infraction juridique relative à des droits d’auteur, de marque ou autre ;

- si quelqu’un clique sur un lien menant vers notre site internet, il devra le faire apparaître sur une nouvelle page et non dans un encadré de votre propre site web.”

Bref historique des versions de Google Penguin

Penguin 1.0 – 24 avril 2012

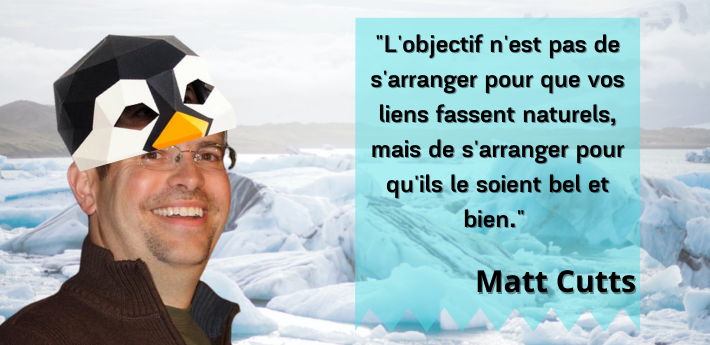

Matt Cutts commence à parler de white hat et de black hat SEO. Il annonce que Penguin est destiné à porter secours à l’algo Panda en défaisant les nœuds provoqués par les techniques abusives de netlinking de la part des webspammers. D’une langue à une autre, on estime que 3% à 5% des requêtes ont été impactées.

Penguin 1.1 – 26 mai 2012

Première mise à jour de Pingouin portant essentiellement sur les données ciblant le webspam. Initialement baptisée Pingouin 1.1, cette v2 sera rebaptisée Penguin 2 dans le milieu, dans lequel on prend au mot toutes les modifications.

Penguin 1.2 – 5 octobre 2012

Nouvelle mise à jour des données, laquelle ne dépasserait pas les 0,4 % d’impact pour les recherches en français, contre 0,3% pour l’anglais.

Penguin 2.0 – 22 mai 2013

Une mise à jour plus complète, déployée dans toutes les langues. L’impact est majeur, avec 2%, voire 3% des requêtes, selon la langue. D’aucuns, prenant en compte les versions précédentes, y font référence sous le nom de “Penguin 4”.

Penguin 2.1 – 4 octobre 2013

Cette mise à jour a influencé pas moins d’1% des recherches, et a été particulièrement visible en France.

Penguin 3.0 – 17 octobre 2014

Ou Penguin 6 est une update qui accentue les pénalités pour les sites trop éloignés des consignes de référencement naturel, particulièrement en ce qui concerne les backlinks.

Penguin 4.0 – 23 septembre 2016

On passe à la version « temps réel », dont la mesure de l’impact (0,4%) semble dérisoire comparée à l’effet ressenti par les webmasters. Frappe chirurgicale ?

Vos questions, nos réponses !

Quelles différences entre l’action de Penguin et une pénalité manuelle ?

Évidemment, les deux cas de figure occasionnent un déclassement. Toutefois, les vraies pénalités proviennent des équipes de webspam de Google, dont l’enquête, due à un signalement préalable, aboutit à une sanction manuelle. Le domaine incriminé reçoit alors une notification sur Google Search Console.

Il sera alors recommandé au webmaster de réaliser un audit de ses backlink, afin de supprimer ou de désavouer les liens de mauvaise qualité.

Il ou elle pourra ensuite procéder à une demande de réexamen, afin de faire lever la pénalité.

Google Penguin fonctionne-t-il en temps réel ?

Oui, depuis 2016 ! Cela signifie que les modifications apportées à votre netlinking seront plus rapidement prises en compte, à condition qu’elles soient bien menées. Il faudra cependant attendre que le bot ait crawlé les pages dans lesquelles un lien aura été amélioré, supprimé, ou désavoué.

Mes améliorations de netlinking white hat semblent inefficaces : pourquoi ?

Il existe plusieurs raisons pour lesquelles vos actions ne vous accorderaient pas un juste retour dans les hauteurs des classements des SERP :

- vous n’avez pas attendu assez longtemps ;

- les backlinks abusifs supprimés ou désavoués qui avaient initialement engendré du trafic artificiel n’ont pas été remplacés ;

- vous avez malencontreusement retiré de bonnes redirections jugées à tort comme étant mauvaises ;

- il reste encore trop de mauvais liens à identifier et à corriger ;

- le problème vient tout simplement d’ailleurs.